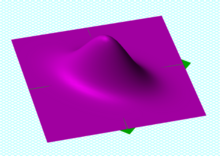

Egy

(

0

;

0

)

{\displaystyle (0;0)}

Σ

=

(

1

0

,

5

0

,

5

1

)

{\displaystyle \mathbf {\Sigma } ={\begin{pmatrix}1&0{,}5\\0{,}5&1\end{pmatrix}}}

A valószínűségszámításban a

Cov

(

X

)

{\displaystyle \operatorname {Cov} (\mathbf {X} )}

kovarianciamátrix pozitív szemidefinit vagy pozitív definit mátrix , ami több valószínűségi változóhoz vagy valószínűségi vektorváltozóhoz definiálható. Átlóján szórásnégyzetek találhatók, a többi elem a megfelelő valószínűségi változók illetve koordináták kovarianciája. Az egydimenziós szórásnégyzet általánosítása.

Legyen

X

{\displaystyle \mathbf {X} }

X

=

(

X

1

X

2

⋮

X

n

)

{\displaystyle \mathbf {X} ={\begin{pmatrix}X_{1}\\X_{2}\\\vdots \\X_{n}\end{pmatrix}}}

Legyen

E

(

X

i

)

=

μ

i

{\displaystyle \operatorname {E} (X_{i})=\mu _{i}}

X

i

{\displaystyle X_{i}}

Var

(

X

i

)

=

σ

i

2

{\displaystyle \operatorname {Var} (X_{i})=\sigma _{i}^{2}}

Cov

(

X

i

,

X

j

)

=

σ

i

j

,

i

≠

j

{\displaystyle \operatorname {Cov} (X_{i},X_{j})=\sigma _{ij}\;,i\neq j}

X

i

{\displaystyle X_{i}}

X

j

{\displaystyle X_{j}}

X

{\displaystyle \mathbf {X} }

E

(

X

)

=

E

(

X

1

X

2

⋮

X

n

)

=

(

μ

1

μ

2

⋮

μ

n

)

=

μ

{\displaystyle \operatorname {E} (\mathbf {X} )=\operatorname {E} {\begin{pmatrix}X_{1}\\X_{2}\\\vdots \\X_{n}\end{pmatrix}}={\begin{pmatrix}\mu _{1}\\\mu _{2}\\\vdots \\\mu _{n}\end{pmatrix}}={\boldsymbol {\mu }}}

vagyis a várható értékek vektora. Az

X

{\displaystyle \mathbf {X} }

[1]

Cov

(

X

)

=

E

(

(

X

−

μ

)

(

X

−

μ

)

⊤

)

=

E

(

(

X

1

−

μ

1

)

2

(

X

1

−

μ

1

)

(

X

2

−

μ

2

)

⋯

(

X

1

−

μ

1

)

(

X

n

−

μ

n

)

(

X

2

−

μ

2

)

(

X

1

−

μ

1

)

(

X

2

−

μ

2

)

2

⋯

(

X

2

−

μ

2

)

(

X

n

−

μ

n

)

⋮

⋮

⋱

⋮

(

X

n

−

μ

n

)

(

X

1

−

μ

1

)

(

X

n

−

μ

n

)

(

X

2

−

μ

2

)

⋯

(

X

n

−

μ

n

)

2

)

=

(

Var

(

X

1

)

Cov

(

X

1

,

X

2

)

⋯

Cov

(

X

1

,

X

n

)

Cov

(

X

2

,

X

1

)

Var

(

X

2

)

⋯

Cov

(

X

2

,

X

n

)

⋮

⋮

⋱

⋮

Cov

(

X

n

,

X

1

)

Cov

(

X

n

,

X

2

)

⋯

Var

(

X

n

)

)

=

(

σ

1

2

σ

12

⋯

σ

1

n

σ

21

σ

2

2

⋯

σ

2

n

⋮

⋮

⋱

⋮

σ

n

1

σ

n

2

⋯

σ

n

2

)

=

Σ

{\displaystyle {\begin{aligned}\operatorname {Cov} (\mathbf {X} )&=\operatorname {E} \left((\mathbf {X} -{\boldsymbol {\mu }})(\mathbf {X} -{\boldsymbol {\mu }})^{\top }\right)\\\\&=\operatorname {E} {\begin{pmatrix}(X_{1}-\mu _{1})^{2}&(X_{1}-\mu _{1})(X_{2}-\mu _{2})&\cdots &(X_{1}-\mu _{1})(X_{n}-\mu _{n})\\\\(X_{2}-\mu _{2})(X_{1}-\mu _{1})&(X_{2}-\mu _{2})^{2}&\cdots &(X_{2}-\mu _{2})(X_{n}-\mu _{n})\\\\\vdots &\vdots &\ddots &\vdots \\\\(X_{n}-\mu _{n})(X_{1}-\mu _{1})&(X_{n}-\mu _{n})(X_{2}-\mu _{2})&\cdots &(X_{n}-\mu _{n})^{2}\end{pmatrix}}\\\\&={\begin{pmatrix}\operatorname {Var} (X_{1})&\operatorname {Cov} (X_{1},X_{2})&\cdots &\operatorname {Cov} (X_{1},X_{n})\\\\\operatorname {Cov} (X_{2},X_{1})&\operatorname {Var} (X_{2})&\cdots &\operatorname {Cov} (X_{2},X_{n})\\\\\vdots &\vdots &\ddots &\vdots \\\\\operatorname {Cov} (X_{n},X_{1})&\operatorname {Cov} (X_{n},X_{2})&\cdots &\operatorname {Var} (X_{n})\end{pmatrix}}\\\\&={\begin{pmatrix}\sigma _{1}^{2}&\sigma _{12}&\cdots &\sigma _{1n}\\\\\sigma _{21}&\sigma _{2}^{2}&\cdots &\sigma _{2n}\\\\\vdots &\vdots &\ddots &\vdots \\\\\sigma _{n1}&\sigma _{n2}&\cdots &\sigma _{n}^{2}\end{pmatrix}}\\\\&=\mathbf {\Sigma } \end{aligned}}}

A várható értékek vektora és a kovarianciamátrix az eloszlás legfontosabb jellemzői- Megadásuk:

X

∼

(

μ

,

Σ

)

{\displaystyle X\;\sim \;({\boldsymbol {\mu }},\mathbf {\Sigma } )}

A különböző elemek száma

n

2

+

n

2

{\displaystyle {\frac {n^{2}+n}{2}}}

n

2

−

n

+

2

2

{\displaystyle {\frac {n^{2}-n+2}{2}}}

X

1

,

…

,

X

n

{\displaystyle X_{1},\ldots ,X_{n}}

Kapcsolat a várható értékkel [ szerkesztés ] Ha

μ

=

E

(

X

)

{\displaystyle {\boldsymbol {\mu }}=\operatorname {E} (X)}

Cov

(

X

)

=

E

(

(

X

−

μ

)

(

X

−

μ

)

⊤

)

=

E

(

X

X

⊤

)

−

μ

μ

⊤

{\displaystyle {\begin{aligned}\operatorname {Cov} (\mathbf {X} )&=\operatorname {E} {\bigl (}(\mathbf {X} -{\boldsymbol {\mu }})(\mathbf {X} -{\boldsymbol {\mu }})^{\top }{\bigr )}\\&=\operatorname {E} (\mathbf {X} \mathbf {X} ^{\top })-{\boldsymbol {\mu }}{\boldsymbol {\boldsymbol {\mu }}}^{\top }\end{aligned}}}

Ahol a vektorok és mátrixok várható értékei koordinátánként értendők.

Egy

μ

{\displaystyle {\boldsymbol {\mu }}}

Cov

(

X

)

=

D

D

⊤

{\displaystyle \operatorname {Cov} (\mathbf {X} )=\mathbf {D} \mathbf {D} ^{\top }}

Ekkor a valószínűségi vektorváltozó:

X

=

D

ξ

+

μ

{\displaystyle \mathbf {X} =\mathbf {D} \mathbf {\xi } +{\boldsymbol {\mu }}}

ahol

ξ

{\displaystyle \mathbf {\xi } }

Két vektor kovarianciamátrixa [ szerkesztés ] Két vektor kovarianciamátrixa

Cov

(

x

,

y

)

=

E

(

(

x

−

μ

)

(

y

−

ν

)

⊤

)

{\displaystyle \operatorname {Cov} (\mathbf {x} ,\mathbf {y} )=\operatorname {E} {\bigl (}(\mathbf {x} -{\boldsymbol {\mu }})(\mathbf {y} -{\boldsymbol {\nu }})^{\top }{\bigr )}}

ahol

μ

{\displaystyle {\boldsymbol {\mu }}}

x

{\displaystyle \mathbf {x} }

ν

{\displaystyle {\boldsymbol {\nu }}}

y

{\displaystyle \mathbf {y} }

Ha

i

=

j

{\displaystyle i=j}

Valós kovarianciamátrix szimmetrikus , mivel a kovariancia szimmetrikus.

A kovarianciamátrix pozitív szemidefinit. Szimmetriája miatt főtengely-transzformációkkal diagonalizálható , és az így kapott mátrix szintén kovarianciamátrix. Mivel a főátlón csak szórásnégyzetek állnak, azért ez pozitív szemidefinit, ezért az eredeti is az.

Megfordítva, minden pozitív szemidefinit

d

×

d

{\displaystyle d\times d}

A szimmetria, pozitív szemidefinitség és diagonalizálhatóság miatt a kovarianciamátrixok ellipszoidként ábrázolhatók.

Minden

A

∈

R

m

×

n

{\displaystyle \mathbf {A} \in \mathbb {R} ^{m\times n}}

b

∈

R

n

{\displaystyle \mathbf {b} \in \mathbb {R} ^{n}}

Cov

(

A

X

+

b

)

=

A

Cov

(

X

)

A

⊤

{\displaystyle \operatorname {Cov} (\mathbf {A} \mathbf {X} +\mathbf {b} )=\mathbf {A} \,\operatorname {Cov} (\mathbf {X} )\mathbf {A} ^{\top }}

Minden

b

∈

R

n

{\displaystyle \mathbf {b} \in \mathbb {R} ^{n}}

Cov

(

X

+

b

)

=

Cov

(

X

)

{\displaystyle \operatorname {Cov} (\mathbf {X} +\mathbf {b} )=\operatorname {Cov} (\mathbf {X} )}

Ha

X

{\displaystyle \mathbf {X} }

Y

{\displaystyle \mathbf {Y} }

Cov

(

X

+

Y

)

=

Cov

(

X

)

+

Cov

(

Y

)

{\displaystyle \operatorname {Cov} (\mathbf {X} +\mathbf {Y} )=\operatorname {Cov} (\mathbf {X} )+\operatorname {Cov} (\mathbf {Y} )}

Ha a regressziós modell alakja

y

i

t

=

x

i

t

T

β

+

e

i

t

{\displaystyle y_{it}={\boldsymbol {x}}_{it}^{T}{\boldsymbol {\beta }}+{\boldsymbol {e}}_{it}}

és az

e

i

t

{\displaystyle {\boldsymbol {e}}_{it}}

V

(

e

)

=

E

(

e

e

T

)

=

(

E

(

e

1

e

1

⊤

)

⋯

E

(

e

1

e

N

⊤

)

⋮

⋱

⋮

E

(

e

N

e

1

⊤

)

⋯

E

(

e

N

e

N

⊤

)

)

=

(

σ

11

I

T

⋯

σ

1

N

I

T

⋮

⋱

⋮

σ

N

1

I

T

⋯

σ

N

N

I

T

)

=

(

σ

11

⋯

σ

1

N

⋮

⋱

⋮

σ

N

1

⋯

σ

N

N

)

⊗

I

T

=

Σ

⊗

I

T

=

Φ

{\displaystyle {\begin{aligned}{\boldsymbol {\operatorname {V} }}(\mathbf {e} )=\operatorname {E} (\mathbf {e} \mathbf {e} ^{T})&={\begin{pmatrix}\operatorname {E} ({\boldsymbol {e}}_{1}{\boldsymbol {e}}_{1}^{\top })&\cdots &\operatorname {E} ({\boldsymbol {e}}_{1}{\boldsymbol {e}}_{N}^{\top })\\\\\vdots &\ddots &\vdots \\\\\operatorname {E} ({\boldsymbol {e}}_{N}{\boldsymbol {e}}_{1}^{\top })&\cdots &\operatorname {E} ({\boldsymbol {e}}_{N}{\boldsymbol {e}}_{N}^{\top })\end{pmatrix}}={\begin{pmatrix}\sigma _{11}\mathbf {I} _{T}&\cdots &\sigma _{1N}\mathbf {I} _{T}\\\\\vdots &\ddots &\vdots \\\\\sigma _{N1}\mathbf {I} _{T}&\cdots &\sigma _{NN}\mathbf {I} _{T}\end{pmatrix}}={\begin{pmatrix}\sigma _{11}&\cdots &\sigma _{1N}\\\\\vdots &\ddots &\vdots \\\\\sigma _{N1}&\cdots &\sigma _{NN}\end{pmatrix}}\otimes \mathbf {I} _{T}\\\\&=\mathbf {\Sigma } \otimes \mathbf {I} _{T}=\mathbf {\Phi } \end{aligned}}}

Hatékonysági kritérium [ szerkesztés ] Egy pontbecslő hatékonysága illetve hatékonysága mérhető a kovarianciamátrixszal, mivel tartalmazza a különböző komponensek közötti kovarianciát. Általában, egy pontbecslő hatékonyságát a kovarianciamátrixszal mérik: minél kisebb a mátrix, annál jobb a becslés. Legyen

θ

~

{\displaystyle {\tilde {\boldsymbol {\theta }}}}

θ

^

{\displaystyle {\hat {\boldsymbol {\theta }}}}

(

K

×

1

)

{\displaystyle (K\times 1)}

θ

{\displaystyle {\boldsymbol {\theta }}}

(

K

×

1

)

{\displaystyle (K\times 1)}

Cov

(

θ

^

)

{\displaystyle \operatorname {Cov} ({\hat {\boldsymbol {\theta }}})}

(

K

×

K

)

{\displaystyle (K\times K)}

Cov

(

θ

^

)

{\displaystyle \operatorname {Cov} ({\hat {\boldsymbol {\theta }}})}

Cov

(

θ

~

)

{\displaystyle \operatorname {Cov} ({\tilde {\boldsymbol {\theta }}})}

Cov

(

θ

~

)

−

Cov

(

θ

^

)

{\displaystyle \operatorname {Cov} ({\tilde {\boldsymbol {\theta }}})-\operatorname {Cov} ({\hat {\boldsymbol {\theta }}})}

[2]

↑ George G. Judge, R. Carter Hill, W. Griffiths, Helmut Lütkepohl , T.C. Lee. Introduction to the Theory and Practice of Econometrics. 1988, S. 43.

↑ George G. Judge, R. Carter Hill, W. Griffiths, Helmut Lütkepohl , T.C. Lee. Introduction to the Theory and Practice of Econometrics. 1988, S. 78.

Ez a szócikk részben vagy egészben a Kovarianzmatrix